Chuẩn hóa dữ liệu thường được xem là một bước tiền xử lý nhỏ lẻ, một thao tác kỹ thuật áp dụng nhanh cho xong trước khi bắt tay vào xây dựng mô hình. Tuy nhiên, trên thực tế, chuẩn hóa không chỉ là một chi tiết kỹ thuật mà là một quyết định mô hình hóa mang tính chiến lược. Khi cùng một tập dữ liệu được xử lý bằng các phương pháp khác nhau, hành vi của mô hình sẽ thay đổi đáng kể. Khoảng cách, độ tương đồng, các thành phần phạt và đường dẫn tối ưu hóa đều bị ảnh hưởng trực tiếp.

Quan trọng hơn, chuẩn hóa không phải lúc nào cũng mang lại lợi ích. Nếu áp dụng sai ngữ cảnh, nó có thể làm giảm hiệu suất của mô hình hoặc tệ hơn là gây ra hiện tượng rò rỉ dữ liệu, làm ô nhiễm toàn bộ quá trình đánh giá. Một ví dụ điển hình là việc tính toán các tham số chuẩn hóa như giá trị trung bình hay độ lệch chuẩn trên toàn bộ tập dữ liệu trước khi chia thành tập huấn luyện và tập kiểm tra. Quá trình này vô tình mang thông tin của tập kiểm tra trộn lẫn vào quá trình huấn luyện, tạo ra những kết quả đánh giá ảo tưởng. Vấn đề cốt lõi không nằm ở bản thân phương pháp, mà ở việc bạn áp dụng nó khi nào và như thế nào.

Bài viết này sẽ coi chuẩn hóa là một phần không thể tách rời của chiến lược mô hình hóa. Chúng ta sẽ cùng nhau giải quyết từng bước các vấn đề nền tảng: tại sao cần chuẩn hóa, khi nào nên áp dụng, thời điểm thực hiện trước hay sau khi chia tập dữ liệu và cách xử lý với từng loại biến số khác nhau.

Phân biệt thuật ngữ chuẩn hóa và tiêu chuẩn hóa

Trong cả tài liệu học thuật lẫn thực tế công việc, hai thuật ngữ này thường được dùng lẫn lộn, gây ra không ít sự nhầm lẫn trong quá trình tiền xử lý dữ liệu. Thực chất, chúng đại diện cho các chiến lược thay đổi thang đo khác nhau, với những giả định và trường hợp sử dụng riêng biệt.

Tiêu chuẩn hóa là quá trình biến đổi một biến số sao cho nó có giá trị trung bình bằng không và độ lệch chuẩn bằng một. Cụ thể, mỗi điểm dữ liệu sẽ được trừ đi giá trị trung bình của mẫu và chia cho độ lệch chuẩn. Phương pháp này giữ nguyên hình dáng phân phối gốc của dữ liệu trong khi đưa các biến về cùng một thang đo có thể so sánh được. Nó đặc biệt hữu ích cho các mô hình nhạy cảm với độ lớn tương đối của các biến dự báo, chẳng hạn như mô hình tuyến tính có điều chuẩn, SVM và mạng nơ ron.

Chuẩn hóa theo nghĩa hẹp thường ám chỉ việc đưa các biến số về một khoảng giá trị cố định, phổ biến nhất là từ không đến một. Mỗi giá trị được biến đổi dựa trên giá trị nhỏ nhất và lớn nhất quan sát được trong tập huấn luyện. Phương pháp này dễ diễn giải nhưng lại rất nhạy cảm với các giá trị ngoại lai, bởi chỉ cần một điểm dữ liệu cực đoan cũng có thể làm sai lệch toàn bộ khoảng tỷ lệ.

Một cách tiếp cận thứ ba thường gặp là chuẩn hóa mạnh, sử dụng trung vị và khoảng tứ phân vị thay vì trung bình và độ lệch chuẩn. Nhờ cấu trúc này, phương pháp ít bị ảnh hưởng bởi các giá trị ngoại lai và các phân phối có đuôi nặng. Đây là giải pháp tuyệt vời cho các tập dữ liệu thực tế nơi các giá trị cực đoan không phải là lỗi mà là những quan sát có ý nghĩa.

Tại sao cần chuẩn hóa dữ liệu?

Sự cần thiết của bước này trở nên rõ ràng khi chúng ta nhận ra rằng nhiều kỹ thuật học máy không hoạt động trực tiếp trên các giá trị thô, mà dựa trên các mối quan hệ dẫn xuất từ chúng như khoảng cách, độ tương đồng, hướng phương sai hoặc thành phần phạt. Khi các biến dự báo được đo lường trên những thang đo khác nhau, các đại lượng dẫn xuất này có thể bị chi phối hoàn toàn bởi những biến có phạm vi số học lớn hơn, bất kể tầm quan trọng thực sự của chúng.

Vấn đề này thể hiện rõ nhất ở các thuật toán dựa trên khoảng cách như KNN và K-means. Các thuật toán này chủ yếu sử dụng khoảng cách Euclid. Nếu một biến chạy từ không đến một trong khi biến khác chạy từ không đến mười nghìn, biến thứ hai sẽ áp đảo hoàn toàn phép tính khoảng cách. Kết quả là sự tương đồng được quyết định bởi độ lớn con số thay vì bản chất dữ liệu.

Chuẩn hóa cũng quan trọng không kém đối với các mô hình tích hợp kỹ thuật điều chuẩn như hồi quy Ridge và Lasso. Trong các mô hình này, hệ số được kiểm soát để giảm độ phức tạp. Tuy nhiên, mức độ phạt lại gắn liền với thang đo của biến dự báo. Nếu không cùng thang đo, cơ chế điều chuẩn sẽ thu hẹp các hệ số một cách không đồng đều, vô tình phạt nặng một số biến chỉ vì đơn vị đo lường của chúng. PCA, SVM hay mạng nơ ron cũng đối mặt với vấn đề tương tự. Ở PCA, các thành phần chính sẽ bị chệch hướng về phía các biến có phương sai lớn nhất nếu dữ liệu không được xử lý trước.

Ngược lại, các mô hình dựa trên cây quyết định như random forest hay gradient boosting thường không bị ảnh hưởng bởi phép biến đổi đơn điệu của từng biến. Vì các nút chia cắt dựa trên thứ tự thay vì khoảng cách hay độ lớn, việc chuẩn hóa thường không cần thiết đối với những phương pháp này.

Có phải lúc nào cũng cần chuẩn hóa?

Câu trả lời ngắn gọn là không. Việc áp dụng vô tội vạ đôi khi còn gây hại hơn là bỏ qua nó. Bạn cần dựa vào đặc tính của mô hình để đưa ra quyết định:

Mô hình bắt buộc áp dụng: KNN, K-means, PCA, SVM, mạng nơ ron, Ridge, Lasso. Khoảng cách, hướng phương sai và thành phần phạt đóng vai trò trung tâm ở đây.

Mô hình không cần thiết: Cây quyết định, random forest, XGBoost. Cấu trúc cây dựa trên thứ tự sắp xếp của giá trị nên hoàn toàn miễn nhiễm với thang đo.

Mô hình tùy biến: Hồi quy tuyến tính thông thường không yêu cầu chuẩn hóa để ước lượng, nhưng có thể cần để đảm bảo tính ổn định số học và giúp diễn giải hệ số dễ dàng hơn. Mô hình Naive Bayes cũng phụ thuộc vào giả định phân phối của từng loại biến cụ thể.

Nên chuẩn hóa trước hay sau khi chia tập dữ liệu?

Đây là câu hỏi quan trọng nhất trong toàn bộ quy trình tiền xử lý. Nguồn gốc của những sai lầm chết người thường xuất phát từ hiện tượng rò rỉ dữ liệu.

Rò rỉ dữ liệu xảy ra khi thông tin bên ngoài tập huấn luyện bị sử dụng trực tiếp hoặc gián tiếp trong quá trình xây dựng mô hình. Nếu bạn tính toán giá trị trung bình hoặc giá trị lớn nhất trên toàn bộ dữ liệu trước khi chia nhỏ, bạn đã cho phép thông tin từ tập kiểm tra rò rỉ vào quá trình tiền xử lý. Điều này tạo ra những đánh giá hiệu suất lạc quan một cách giả tạo.

Nguyên tắc cốt lõi không thể thỏa hiệp: Các tham số chuẩn hóa phải được học duy nhất từ tập huấn luyện. Sau khi đã học được, chính phép biến đổi đó với các tham số đã cố định sẽ được áp dụng cho tập kiểm tra và bất kỳ dữ liệu mới nào trong tương lai.

Cách làm sai: Tính trung bình và độ lệch chuẩn trên toàn bộ dữ liệu, chuẩn hóa tất cả, sau đó mới chia tập huấn luyện và tập kiểm tra để chạy mô hình.

Cách làm đúng: Chia dữ liệu thành tập huấn luyện và tập kiểm tra trước. Chỉ dùng tập huấn luyện để tính các tham số chuẩn hóa. Dùng chính các tham số đó để biến đổi tập huấn luyện và tập kiểm tra. Cuối cùng mới đưa vào mô hình.

Loại dữ liệu nào cần chuẩn hóa?

Quyết định chuẩn hóa không bao giờ được tách rời khỏi loại dữ liệu. Việc áp dụng chung một công thức cho mọi biến số sẽ dẫn đến những biểu diễn sai lệch.

Biến số thực: Đây là ứng viên hàng đầu. Tùy thuộc vào sự xuất hiện của giá trị ngoại lai mà bạn có thể chọn tiêu chuẩn hóa thông thường, khoảng từ không đến một hoặc chuẩn hóa mạnh.

Biến đếm và biến thứ bậc: Những biến này dù lưu dưới dạng số nhưng bản chất là số đếm hoặc xếp hạng. Việc biến đổi logarit hoặc lũy thừa để giảm độ lệch trước khi chuẩn hóa thường mang lại hiệu quả tốt hơn.

Biến phân loại: Tuyệt đối không chuẩn hóa trực tiếp. Giá trị của chúng mang ý nghĩa định tính. Bạn phải chuyển đổi chúng bằng kỹ thuật mã hóa one-hot trước. Sau khi mã hóa, việc có chuẩn hóa các biến mới tạo ra hay không sẽ phụ thuộc vào việc mô hình của bạn có cần mọi thứ nằm trên cùng một thang đo khắt khe hay không.

Biến nhị phân: Bản thân chúng đã nằm trên một thang đo cố định và dễ hiểu. Việc biến đổi chúng thường không cần thiết và đôi khi làm mờ đi khả năng diễn giải.

Biến mục tiêu: Trong đa số các bài toán dự đoán, biến mục tiêu không nên bị can thiệp. Việc thay đổi thang đo của biến mục tiêu không giúp mô hình ước lượng tốt hơn mà chỉ làm quá trình giải thích kết quả thêm phức tạp, ngoại trừ một số trường hợp đặc thù trong mạng nơ ron.

Thực hành trong R: Dữ liệu và kịch bản mô hình hóa

Để minh họa các hệ quả thực tế, chúng ta sẽ sử dụng tập dữ liệu giá nhà Ames. Mục tiêu không phải là xây dựng mô hình dự đoán tốt nhất, mà là tạo ra một môi trường có kiểm soát để quan sát cách các chiến lược tiền xử lý tác động đến hiệu suất mô hình hồi quy KNN.

1library(tidymodels)

2library(modeldata)

3data(ames, package = "modeldata")

4set.seed(2026)

5ames_small <- ames %>%

6 dplyr::select(

7 Sale_Price,

8 Gr_Liv_Area,

9 Lot_Area,

10 Year_Built,

11 Overall_Cond,

12 Latitude,

13 Longitude

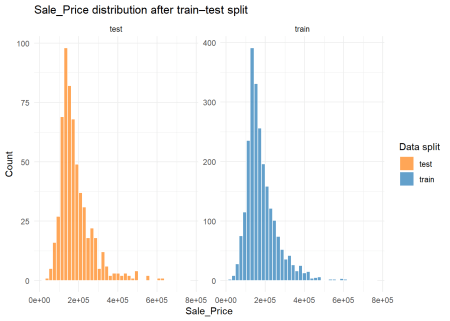

14 )Bước tiếp theo là tạo tập huấn luyện và tập kiểm tra. Chúng ta sẽ chia theo tỷ lệ tám mươi phần trăm cho huấn luyện và sử dụng phân tầng dựa trên biến mục tiêu giá nhà.

1set.seed(2026)

2split_obj <- initial_split(ames_small, prop = 0.80, strata = Sale_Price)

3train_data <- training(split_obj)

4test_data <- testing(split_obj)

Biểu đồ phân phối ở trên cho thấy tập huấn luyện và tập kiểm tra duy trì được cấu trúc dữ liệu tương đồng nhau, đảm bảo không có sự mất cân bằng nghiêm trọng làm sai lệch quá trình đánh giá.

Chúng ta sẽ thiết lập một mô hình KNN với số lượng điểm lân cận bằng mười lăm. Mô hình này sẽ được giữ nguyên xuyên suốt các kịch bản để đảm bảo mọi sự thay đổi về hiệu suất đều bắt nguồn từ kỹ thuật tiền xử lý.

1knn_spec <- nearest_neighbor(

2 neighbors = 15,

3 weight_func = "rectangular"

4) %>%

5 set_engine("kknn") %>%

6 set_mode("regression")Kịch bản 1: Đường cơ sở không chuẩn hóa

Ở kịch bản này, chúng ta để nguyên dữ liệu thô. Do KNN dựa trên khoảng cách, các biến có phạm vi số học lớn như diện tích lô đất sẽ chi phối hoàn toàn việc dự đoán.

1rec_none <- recipe(Sale_Price ~ ., data = train_data)

2wf_none <- workflow() %>%

3 add_recipe(rec_none) %>%

4 add_model(knn_spec)

5fit_none <- fit(wf_none, data = train_data)

6pred_none <- predict(fit_none, test_data) %>%

7 bind_cols(test_data %>% dplyr::select(Sale_Price))

8metrics_none <- yardstick::metrics(

9 pred_none,

10 truth = Sale_Price,

11 estimate = .pred

12)

13metrics_noneKịch bản 2: Chuẩn hóa sai cách gây rò rỉ dữ liệu

Tại đây, chúng ta cố tình học các tham số tiền xử lý trên toàn bộ tập dữ liệu, sau đó mới áp dụng mô hình.

1rec_leak <- recipe(Sale_Price ~ ., data = ames_small) %>%

2 step_normalize(all_numeric_predictors())

3prep_leak <- prep(rec_leak, training = ames_small)

4train_leak <- bake(prep_leak, new_data = train_data)

5test_leak <- bake(prep_leak, new_data = test_data)

6wf_leak <- workflow() %>%

7 add_model(knn_spec) %>%

8 add_formula(Sale_Price ~ .)

9fit_leak <- fit(wf_leak, data = train_leak)

10pred_leak <- predict(fit_leak, test_leak) %>%

11 bind_cols(test_leak %>% dplyr::select(Sale_Price))

12metrics_leak <- yardstick::metrics(pred_leak, truth = Sale_Price, estimate = .pred)

13metrics_leakBạn sẽ thấy hiệu suất giảm đi. Điều này chứng minh rằng rò rỉ dữ liệu không phải lúc nào cũng làm tăng hiệu suất mô hình một cách ảo tưởng, nhưng nó chắc chắn làm cho quá trình đánh giá mất đi tính hợp lệ.

Kịch bản 3: Chuẩn hóa đúng quy trình

Tham số chuẩn hóa chỉ được học trên tập huấn luyện và sau đó áp dụng một chiều sang tập kiểm tra.

1rec_ok <- recipe(Sale_Price ~ ., data = train_data) %>%

2 step_normalize(all_numeric_predictors())

3wf_ok <- workflow() %>%

4 add_recipe(rec_ok) %>%

5 add_model(knn_spec)

6fit_ok <- fit(wf_ok, data = train_data)

7pred_ok <- predict(fit_ok, test_data) %>%

8 bind_cols(test_data %>% dplyr::select(Sale_Price))

9metrics_ok <- yardstick::metrics(pred_ok, truth = Sale_Price, estimate = .pred)

10metrics_okKết quả cho thấy phương pháp chuẩn hóa đúng cách khôi phục lại hiệu suất tương đương với đường cơ sở. Chuẩn hóa không tự động làm tăng độ chính xác của mô hình, nó chỉ định hình lại cách mô hình nội suy cấu trúc dữ liệu.

Qua việc so sánh trực quan các sai số bình phương trung bình, chúng ta rút ra bài học cốt lõi: tính đúng đắn của quy trình tiền xử lý quan trọng hơn việc bạn chọn phương pháp cụ thể nào. Một quy trình sạch, không rò rỉ thông tin là nền tảng để xây dựng các mô hình có khả năng tổng quát hóa thực sự.

✨ Giá trị đắt giá: Tiền xử lý dữ liệu không phải là bước kỹ thuật diễn ra trước khi lập mô hình; nó chính là một phần của mô hình. Việc chia tách tập dữ liệu phải luôn là hành động đầu tiên bạn thực hiện. Mọi tham số đo lường, kể cả đơn giản nhất như trung bình hay trung vị, đều phải được cô lập tuyệt đối bên trong tập huấn luyện để bảo vệ sự trung thực của tập kiểm tra.

Bạn thường áp dụng phương pháp nào để biến đổi các biến có phân phối lệch mạnh trước khi đưa chúng về cùng một thang đo? Hãy xem xét kỹ tập dữ liệu hiện tại của bạn, liệu có biến định lượng nào đang được mã hóa dưới dạng số học nhưng bản chất lại là các hạng mục phân loại không?